DeepSeekが推論モデル「R1」をわずか4400万円でトレーニングしたと発表、512基のNVIDIA H800チップを80時間使用

2025年1月、中国のAIスタートアップであるDeepSeekは独自の強力な推論モデルである「DeepSeek R1」をリリースしました。リリース直後、アメリカの株式市場が暴落するほど競合AIモデルにとって驚異的なコストパフォーマンスをしているDeepSeek R1ですが、これまで謎に包まれていたDeepSeek R1のトレーニングコストなどの詳細をDeepSeekが明らかにしました。

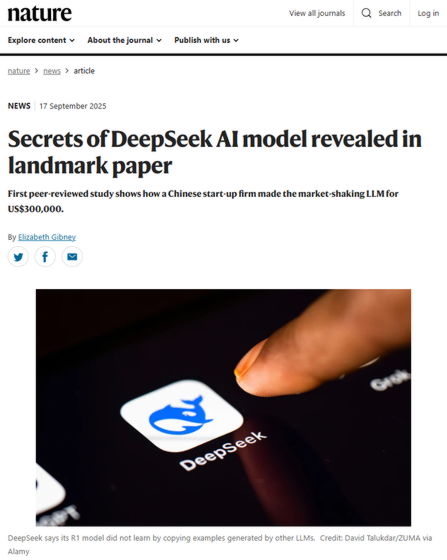

Secrets of DeepSeek AI model revealed in landmark paper

https://www.nature.com/articles/d41586-025-03015-6

China's DeepSeek says its hit AI model cost just $294,000 to train | Reuters

https://www.reuters.com/world/china/chinas-deepseek-says-its-hit-ai-model-cost-just-294000-train-2025-09-18/

DeepSeek bolsters AI 'reasoning' using trial-and-error • The Register

https://www.theregister.com/2025/09/18/chinas_deepseek_ai_reasoning_research/

DeepSeek says AI model cost just $294K to train: report

https://www.proactiveinvestors.com/companies/news/1078747/deepseek-says-ai-model-cost-just-294k-to-train-report-1078747.html

DeepSeek R1は数学やコーディングといった「推論」タスクに優れた性能を発揮するよう設計されたAIモデルで、アメリカのテクノロジー企業が開発した競合AIモデルよりも低コストで開発された点が大きな注目を集めました。なお、DeepSeek R1はオープンウエイトモデルであり、誰でもダウンロード可能。AIコミュニティプラットフォームのHugging Faceで最も人気が高いAIモデルのひとつで、記事作成時点で既に1090万回以上ダウンロードされています。

DeepSeekはどのようにしてOpenAIの3%のコストでo1を超えたのか? - GIGAZINE

2025年9月17日、DeepSeekが科学誌のNatureで推論モデルDeepSeek R1に関する査読付きの論文を公開しました。論文では、DeepSeekは通常の大規模言語モデル(LLM)を推論タスクに対応するようにどのように強化したかが解説されています。また、補足資料の中でDeepSeek R1のトレーニングコストが初めて明かされており、その金額はわずか29万4000ドル(約4400万円)でした。

DeepSeekはDeepSeek R1の基盤となるLLMを開発するために600万ドル(約8億9000万円)を投じていますが、競合他社のAI開発コストと比べると、はるかに安価です。また、DeepSeekはDeepSeek R1のトレーニングに使用したAIチップについて、「DeepSeek R1は512基のNVIDIA製のH800チップで構成されたクラスターで、合計80時間にわたってトレーニングされた」とも言及しています。

この論文が公開されたことで、DeepSeek R1は査読プロセスを経た初の著名LLMとなりました。これについて、論文の査読を担当したHugging Faceの機械学習エンジニアであるルイス・タンスティル氏は、「これは非常に歓迎すべき前例です」「プロセスの大部分を公開して共有する慣習がなければ、こうしたシステムがどのようなリスクを持っているか評価することは非常に困難です」と語っています。

タンスティル氏の査読コメントに対して、DeepSeekの開発チームはモデルの記述から擬人化表現を減らし、トレーニングデータの種類や安全性といった技術的詳細の説明を追加しました。アメリカのオハイオ州立大学でAI研究者として働くファン・サン氏は、「厳格な査読プロセスを経ることで、AIモデルの妥当性や有用性が検証されるのは確かです」「他社も同じように査読を受けるべきです」とコメントしています。

DeepSeekの主な技術革新は、「純粋強化学習」と呼ばれる自動試行錯誤法を使ってDeepSeek R1をトレーニングした点です。このプロセスは、人間が選んだ推論例を教えるのではなく、正解に到達した場合にAIモデルが報酬を得られるよう設計するというもの。DeepSeekによると、これによりAIモデル自体が「人間が教えたやり方をなぞらず自身の作業を検証する」などの推論的な戦略を学習したそうです。

また、DeepSeekはトレーニングの効率化のために、「グループ相対方策最適化(GRPO:Group Relative Policy Optimization)」と呼ばれる手法を採用しています。これは試行ごとに独自に推定評価を下し、別のアルゴリズムを使うことなく自己評価を行うというものです。

サン氏はDeepSeek R1について、「AI研究者の間でかなり大きな影響を持ちました」「2025年に入ってLLMに強化学習を適用した研究のほぼすべてが、何らかの形でDeepSeek R1から影響を受けているかもしれません」と語っています。

・関連記事

OpenAI o1相当の推論モデル「DeepSeek R1」を中国AI企業が商用利用や改変が可能なMITライセンスでリリース - GIGAZINE

DeepSeekはどのようにしてOpenAIの3%のコストでo1を超えたのか? - GIGAZINE

中国のAI「DeepSeek」ショックでハイテク株がパニック売りに、NVIDIAの時価総額が91兆円消し飛んで暴落記録を2倍以上更新 - GIGAZINE

DeepSeek-R1のサイズを最大80%削減した動的量子化モデルが公開中 - GIGAZINE

DeepSeekの推論モデル「DeepSeek-R1」をOpenAIのo1&o3と比較することで明らかになったこととは? - GIGAZINE

「DeepSeek-R1」は中国に関するデリケートな話題の85%に回答することを拒否、ただし簡単に制限を回避できるとの指摘 - GIGAZINE

DeepSeek-R1の開発企業が独自技術を次々にオープンソース化、AIの学習や推論を高速化可能 - GIGAZINE

中国製AI「DeepSeek」は中国政府の好まない相手向けにわざと低品質な回答を出力している可能性あり - GIGAZINE

・関連コンテンツ

in ソフトウェア, Posted by logu_ii

You can read the machine translated English article DeepSeek announces that it trained the i….